¿Cuál es el concepto científico que más os gusta? Uno que cuando lo entendisteis os resultó una revelación.

Algo así preguntaron el otro día en twitter. Pensé en uno. Y cuanto más lo pensaba, más claro lo veía. Porque no fue una única revelación, sino que han sido varias a lo largo del tiempo. Para mí, ya no es algo solo científico. De hecho, si lo cuento en El Lento Ahora es porque ha tenido una influencia notable en muchísimo de lo que he escrito -más bien- literario.

Se trata de un concepto de fondo, que conecta aspectos tan fundamentales de nuestro universo y de la forma en que lo percibimos como son el (des)orden, el fluir del tiempo, la información, la identidad o la vida. De forma profunda. Esencial. A su manera, incluso, se podría decir que los define.

Se llama entropía. Y es esquivo.

Por cierto, reconozco que no manejo el concepto con la claridad del especialista en el tema pero creo que estoy lo suficientemente familiarizado con él como para hilvanar los puntos y tratar de transmitir mi fascinación.

Vamos con ello.

LO PRIMERO ES AGARRARLA

La entropía no tiene una única definición porque se usa -y se usa porque aparece-, en muchas otras ramas de la ciencia con sutiles variantes. La primera aproximación, la más intuitiva, es la que la presenta como una medida del grado de desorden de un sistema. Obvio decir que, por tanto, también sirve para medir el orden. Sin embargo, es mucho más que eso. La palabra, traída del griego, significa “evolución” o “transformación”. Y ésa es una gran pista de lo que realmente significa. Porque establece la irreversibilidad de algunos fenómenos físicos.

El concepto nace con la termodinámica -de hecho es uno de sus principios fundamentales-. Se llegó a ella cuando, estudiando la transferencia de calor, se hizo necesario responder a una cuestión extraña: por qué, a pesar de que la energía total de un sistema aislado es siempre constante (ley de conservación de la energía), algunos procesos se producen de forma espontánea y otros no.

El ejemplo clásico: Imaginad una caja perfectamente aislada del mundo, en la que hay un vaso con hielo. El hielo se derretirá convirtiéndose en agua, por el camino se enfriará algo el vaso y el aire. Llegado un momento, todos los elementos del sistema (agua, vaso y aire) tendrán la misma temperatura. La energía total del sistema será idéntica a la que teníamos al comenzar en todos los momentos del proceso hasta que se equilibre. Sin embargo, nunca, en ningún caso, el agua volverá a convertirse espontáneamente en hielo.

Todo esto nos resulta intuitivo y razonable con nuestra experiencia del mundo. Pero partiendo solo de la conservación de la energía no habría ningún motivo para pensar que una cosa tan rara no pudiera suceder. Que no se formen de pronto cristales de hielo por una “reordenación” del calor del sistema. Sabemos con certeza que eso no ocurrirá jamás, ¿cierto?

Pues resulta que no es evidente. Hasta el punto de que hizo falta inventar el concepto de entropía para explicar eso.

De alguna manera -a la que llegamos en breve- el estado “cristal de hielo” se trata de un estado mucho más ordenado que el estado “agua en un vaso”. De manera que el “desorden” de un sistema siempre aumenta o, al menos, nunca disminuye. Y esto es chocante. ¿Algo que aumenta siempre? Sí. La entropía del universo está en permanente crecimiento. ¿Pero esto cómo puede ser? ¿Dónde está el límite de ese fenómeno?

Pero me estoy adelantando.

Más adelante, cuando se empezó a entender el mundo de las partículas elementales, se llegó a una definición más formal de la entropía que tiene que ver con la estadística y la combinatoria. Tiene que ver con el resultado neto de un número inconmensurable de fenómenos físicos en los niveles atómico y subatómico, todos ellos aleatorios. Porque lo aleatorio, cuando ocurre muchas veces, acaba siendo muy determinista.

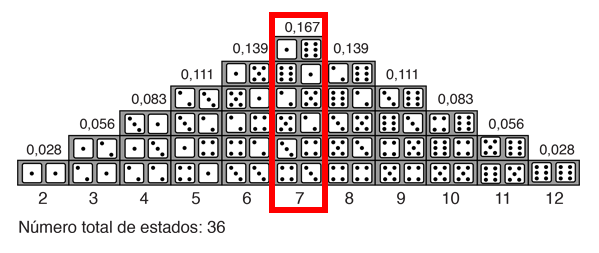

Un ejemplo rápido: Puede que no sepamos cual va a ser el resultado de tirar un dado. Pero sí sabemos que si tiramos dos dados, lo más probable es que sus caras sumen siete. Porque es la suma que admite más combinaciones posibles, 6 de 36 posibles (el 16’7%), las que señalo en rojo: Entonces resulta todavía más probable que si tiramos cuatro, sus caras sumen 14. ¿Seis dados? 21 es, con mucho, la suma más probable, porque el número de combinaciones posibles respecto del total aumenta. Aquí se ve el valor medio para 1 dado (linea roja), 2 (línea verde), 3 (línea naranja) 10 (linea azul), 60 (línea gris) y 600 dados (linea negra). Como veis, el valor medio es cada vez más y más cercano a 3’5 y el resto de posibilidades se va volviendo más y más improbable.

Entonces resulta todavía más probable que si tiramos cuatro, sus caras sumen 14. ¿Seis dados? 21 es, con mucho, la suma más probable, porque el número de combinaciones posibles respecto del total aumenta. Aquí se ve el valor medio para 1 dado (linea roja), 2 (línea verde), 3 (línea naranja) 10 (linea azul), 60 (línea gris) y 600 dados (linea negra). Como veis, el valor medio es cada vez más y más cercano a 3’5 y el resto de posibilidades se va volviendo más y más improbable.

Y esto es siempre así sucesivamente. De manera que si tiramos dos mil millones de dados, es casi imposible que sus caras no sumen algo extraordinariamente parecido a 7.000 millones.

Nota 1: Quien quiera, puede profundizar en este tema en la maravillosa explicación sobre la entropía que hizo Aatish Bhatia en su blog y de la que he sacado los gifs anteriores.

Estirando desde este ejemplo de los dados, podemos empezar a entender una segunda definición, más moderna, de lo que es la entropía. En la que es un valor relacionado directamente con el “número de micro-estados equivalentes” para una situación del sistema. Viene a decir que nos da igual que el primer dado que tiro sea un 3 y el segundo un 2 que viceversa. Que si lo que estamos mirando es la suma neta, ambos son equivalentes. Y también que el primero sea un 1 y el segundo un 4. O viceversa. Para calcular la entropía hay que saber cuántas combinaciones distintas encajan con el resultado total de la suma que estamos viendo. Cuanto mayor sea el número de combinaciones compatibles, mayor es la entropía.

A partir de aquí, ya se pueden hacer dos lecturas brutales.

LO SEGUNDO ES EMPEZAR A VER la magia

Resulta que, en nuestro universo, todo evoluciona hacia su configuración más probable. Cualquier sistema que cambie con el tiempo (es decir, prácticamente cualquier sistema) lo hace en la dirección en la que la entropía aumenta. Esto es lo mismo que decir la más frecuente. Y también que decir la más “inespecífica”, la más desordenada.

Una implicación de esto, por tanto, es que si la entropía sólo puede aumentar con el discurrir del tiempo, de alguna manera se puede utilizar para identificar qué fue antes y qué después en un sistema dado. Dicho de otra manera: marca la dirección en la que avanza el tiempo.

De manera intuitiva: si viéramos la foto del vaso con hielos y la del vaso con agua, y si sabemos que no ha habido ninguna intervención externa, que nadie ha tocado nada, ¿alguien tendría dudas sobre qué ocurrió primero y qué después?

Pues así con todo.

A este concepto de dirección, de irreversibilidad, se le llama flecha del tiempo. Resulta que el tiempo, quién lo iba a decir, es asimétrico. Algo que, una vez más, puede parecernos obvio, pero no es evidente.

Antes he comentado que la entropía siempre aumenta, ¿verdad? Pues resulta que una de las conjeturas clásicas sobre el fin del universo es el de su “muerte térmica”. Y viene a decir que, cuando todas las interacciones y fenómenos físicos de todo tipo (químicos, cuánticos, gravitatorios…) del universo hayan concluido, cuando todas las transferencias se hayan realizado y el último agujero negro se haya consumido, la entropía del universo habrá alcanzado su máximo. Nada podrá volver a interactuar con nada, para nunca jamás. Será el fin del tiempo. Game Over:

LO TERCERO ES YA RESULTAR MOLESTA

De la definición anterior, la de los microestados compatibles, se puede hacer otra lectura curiosa. Cuando se dice que el estado al que tiende como es el más inespecífico significa, básicamente, que no podemos distinguir en cual nos encontramos de entre todos los estados posibles.

Volvemos un segundo a los dados:

- Si os digo que la suma de dos dados es 7, existen 6 maneras de conseguirlo: 1+6, 2+5, 3+4, 4+3, 5+2, 6+1. La entropía es máxima. Y, además, tampoco podemos descartar ninguna posibilidad para un dado en concreto. Da igual lo que haya salido en uno de ellos, en el otro siempre hay una posibilidad de que la suma de 7.

- Si, por ejemplo, hubiera salido una suma 4, entonces sólo podrían ser 3 opciones: 1+3, 2+2, 3+1. La entropía es más baja y, por el camino, podemos aprender algo. Podemos descartar con seguridad los resultados 4, 5 y 6 para cualquiera de los dados. Lo cual ya es saber bastante de lo que ha pasado en la tirada.

- Sin embargo, si la suma de ambos dados es 2, resulta que sólo existe una forma de conseguirlo: 1+1. Es decir, tenemos toda la información posible sobre la tirada de dados, sabemos con certeza lo que ha salido en cada dado. La entropía entonces es mínima.

De esta relación entre entropía e información surge una relación muy profunda: cuanto más improbable es un fenómeno, más información nos aporta. Las implicaciones de esto en Teoría de la Información son tremendas. Todas nuestras nuevas tecnologías, –bien sea para almacenar, transmitir, codificar o cifrar los datos- se apoyan, van de la mano, de ese extraño concepto que llamamos entropía.

Curiosamente, uno de los padres de esta ciencia –Shannon– llegó por su cuenta a la fórmula de la entropía sin ser consciente de que ya existía algo así en en la termodinámica. Su colega, Von Neumann, que sí la conocía, le propuso llamar a su nuevo concepto entropía porque como “nadie sabe verdaderamente lo que es, tendrás ventaja en los debates”.

Pero volvamos. Relacionemos los dos puntos anteriores:

- Por un lado, resulta que el mero paso del tiempo nos hace ir hacia el estado más probable, hacia el de mayor entropía.

- Por otro, sabemos que, cuando aumenta la entropía, se pierde la información.

Existe, de hecho, una tercera definición de la entropía que dice: “un sistema aislado evoluciona siempre a un estado donde aumenta su información perdida”.

No sé a vosotros, pero a mí, ésto ya me empieza a parecer una locura. Resulta que el universo, a través de una de sus leyes más fundamentales, se está encargando de destruir toda la información. Mi espíritu archivista y algo nostálgico experimenta un profundo desasosiego ante esta idea.

Porque no hay escapatoria: el paso del tiempo lleva a la inmemoria.

Nota 2: Casi todo lo que he contado hasta este punto, está muy bien desarrollado, con estilo youtuber en el canal de Date un Vlog.

y aquí VA DONDE LA MATAN

Fijaos que, básicamente hablando de tirar muchos dados, hemos llegado a algo parecido a una definición del tiempo y su final, de que el universo tiene una perniciosa tendencia a buscar el desorden y de la pérdida de información. Pero es que hay un tema adicional que es donde ya me explota la cabeza.

Resulta que el mero concepto de vida, LA VIDA, puede entenderse como un intento de perpetuar la información frente al paso del tiempo.

De entre las muchas definiciones de vida que existen, probablemente la mejor y más completa venga del área de la termodinámica. Atención a esto:

“Los sistemas vivos son una organización especial y localizada de la materia, donde se produce un continuo incremento de orden sin intervención externa”.

Según todo lo dicho, la entropía y el desorden de un sistema aislado siempre aumenta. Pero un ser vivo lo que pretende es precisamente lo contrario. Interactuar con el entorno, para perdurar. El sistema completo (<ser vivo>+<su entorno>) seguirá respetando la termodinámica y, el resultado neto, hará que la entropía total aumente. Pero el ser, mientras tenga vida, mantendrá una pugna constante contra esa pérdida de orden, hará lo posible por mantener su estructura, su autonomía.

La vida es la lucha de determinadas estructuras contra la entropía. Contra lo que el tiempo hace con la materia y con la información.

Una batalla, ya lo sabemos, perdida de antemano.

Ahondando en esa línea de pensamiento, se puede interpretar que el ADN/ARN como el código en el que está escrito cómo resistir al tiempo. Cómo construir unas proteínas, cuyas estructuras suelen ser extraordinariamente complejas y específicas -todo lo contrario a lo esperable por el segundo principio de la termodinámica-, que se encargan de definir al ser vivo y manternerlo tal y como es, intercambiando sustancias con el medio sin alterarse. Más aún: para no alterarse.

Una perspectiva interesante sobre esto, es que los seres vivos no somos, esencialmente, la materia de la que estamos hechos. La inmensa mayoría de nuestras células y también de los átomos que nos componen no permanecen como parte de nosotros durante demasiado tiempo. Se habla de un plazo de entre 5 y 10 años, según cómo lo miremos. En ese periodo, la casi totalidad de nuestras células habrán muerto y habrán sido sustituidas por otras. Pero incluso de las que siguen vivas, la casi totalidad de sus átomos habrá variado por otros equivalentes. Pero seguimos siendo “nosotros”, ¿cierto? En realidad, es la estructura que tiene esa materia la que nos configura. No es descabellado decir por tanto que, de manera profunda, lo que nos hace ser como somos, se puede definir mejor en términos de información que de materia. La identidad, incluso en el plano más meramente físico, es codificable como información.

En nuestra tradición, alguien escribió hace mucho tiempo el mandato de la vida como «creced y multiplicaos«:

- Creced mediante los dos tipos de reacciones metabólicas. Las anabólicas: mantente como eres, sintetiza tu propia materia para construirte y reconstruirte una y mil veces tal y como dicta tu ADN. Adápatate. Las catabólicas: para conseguirlo, en este universo y con estas reglas, necesitas energía. Obtenla de tu entorno como puedas.

- Multiplicaos: Replica y mejora ese código de partida. Evoluciona. Introduce variaciones en futuras versiones de lo que eres, para poder seguir permaneciendo en un entorno que no deja de cambiar.

¿Qué es la muerte, entonces? Abandonar esa resistencia a la entropía. Descomponerse. Devolver los átomos al desorden. Hacerlos indistinguibles del resto de materia de su medio. Puede que por el camino salten de un ser vivo a otro y a otro, durante muchos ciclos. Pero al final, así terminará todo.

Todos los finales son victorias de la entropía.

un epílogo personal

Si soy sincero, no sé muy bien a qué público estoy escribiendo todo esto. Pero sé que me lo quería escribir a mí. Porque últimamente lo hago poco. Y menos aún sobre el tema que me dé la gana, estableciendo relaciones medio locas. Pero lo que no quiero es perder la idea de que este Lento Ahora siga siendo mi “página -más bien- literaria”.

Mientras elaboraba todo este texto, no podía dejar de pensar en el territorio fértil para la creatividad que me resultan todos estos conceptos.

En la literatura grandes autores han hablado de estos temas. Martin Amis, hizo un recomendable experimento literario invirtiendo La Flecha del Tiempo. Y Phillip K. Dick en su “¿Sueñan los androides con ovejas eléctricas?”, la novela en la que se basó Blade Runner, hace continuas referencias al Kipple. Rebautizando la entropía, con una jerga nueva, para hacerla más cercana, tal vez.

Pero he descubierto durante la escritura de esta esta entrada, que me ha llevado meses, que hace mucho tiempo que vuelvo constantemente sobre estos conceptos. La cantidad de juegos creativos que me ofrece es inmensa. Y resulta que he escrito sobre otros usos del ADN puede vencer al paso del tiempo, o servir como invasor, sobre la incongruencia de la vida eterna, o de nuestra experiencia mortal, sobre la lucha contra el envejecimiento, la inmortalidad de los maestros –o su negación-, sobre la absurda irreversibilidad del tiempo y la permanencia, sobre la casualidad y el sentido, sobre la lucha contra la inmemoria y su aceptación final.

Resulta que la entropía estaba ahí también, de fondo, en tantos de mis propios escritos.

O quizá es que esté pelín obsesionado…

Pero, así, entre nosotros, ¿no es como para estarlo?

Hermosas reflexiones!! Todo un gustazo leerte

Gracias por no guardartelo! ;)

Y una mierda! (Con perdón) me niego a pensar que la entropía ganará, la lucha no será fútil, cualquier civilización Tipo III kardashev podrá doblegarse ante la entropía pero no ganará la batalla aún en ciclos infinitos en que la vida inteligente tenga que migrar a otros Universos o de diseño propio y esto se hará eternamente, la entropía aniquila el universo》 los seres inteligentes migran o crean nuevos universos》 la entropía vuelve ha destruir el universo….. y así.

Claro que si subimos más en la escala Kardashev Tipo 4 o 5 (especulación por supuesto) , la idea de Kurzweil de salvar al universo o alcanzar un punto Omega de Tipler (aniquilar el propio Universo para recrear uno nuevo virtual sin entropía y con una civilización virtualmente omnipotente no están descabellado, para David Deutsch y Michio Kaku con suficiente tiempo y conocimiento puede que logremos convertirnos en verdaderos dioses y señores del Universo e incluso doblegar a la inexorable entropía. Una esperanza ilusoria o no pero que ayuda a seguir luchando cada día.

Pensamientos de ducha, un intento de pensar en positivo en el futuro del cosmos añadiendo la ecuación de la vida inteligente, porque sino el universo estará destinado a la total aniquilación y muerte eterna. Cada uno por supuesto es libre de pensar quien ganará la entropía o la vida inteligente. Yo personalmente opino lo segundo, Sean Carroll por supuesto opinará lo primero.

Hola FR,

Lo primero de todo, gracias por tu comentario. Aunque estaba familiarizado con la escala de civilizaciones de Kardashev y conocía algo de Kurzweil, me has llevado a leer varias cosas interesantes. He aprendido y te lo agradezco.

Pero sinceramente, en este caso, me voy a posicionar fuerte con Carroll, sí. :D

Todo lo que comentas es extraordinariamente especulativo. Y, por mucho que cada fibra de nuestra ser se resista a aceptar la victoria final de la entropía, (que tampoco deja de ser una conjetura, es cierto) existe infinito más peso de la evidencia en ese extremo de la balanza.

Pero está bien, sí, que nuestros cerebros primates se agarren con uñas y dientes a la resistencia. Considero que de ahí nace lo mejor de nosotros. Y entiendo que eso es lo mejor que podemos ir haciendo …mientras tanto. ;)